日均數據量千萬級場景下,MySQL與TiDB存儲方案的落地對比與實踐解析

在當今數據驅動的時代,日均數據量達到千萬級別已成為許多互聯網企業與數字化平臺的常態。面對海量數據的實時寫入、高效查詢與穩定存儲,傳統單機數據庫往往力不從心,分布式架構成為必然選擇。本文將以日均數據處理千萬級為背景,深入對比兩種主流存儲方案——經典的關系型數據庫MySQL(通常指其集群或分布式解決方案,如MySQL Group Replication、MySQL NDB Cluster或基于中間件分片的架構)與原生分布式數據庫TiDB,從數據處理與存儲支持服務的核心維度,探討其落地實踐中的優劣與選型建議。

一、 架構設計與擴展性

MySQL(分片架構):

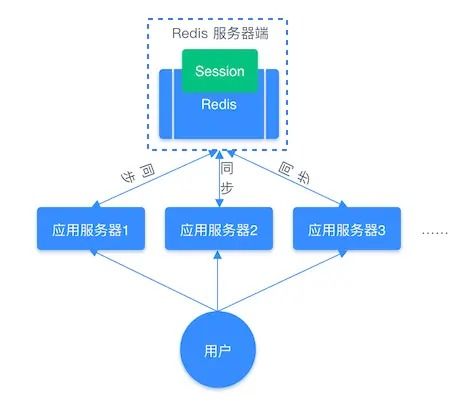

在千萬級日增量的場景下,通常采用“分庫分表”中間件(如ShardingSphere、MyCAT)或云服務商提供的代理分片方案。其核心思想是將數據水平拆分到多個MySQL實例上,通過應用層或中間件路由規則實現數據的分散存儲與訪問。

- 優點: 技術生態成熟,有大量成功案例和運維經驗可循;對事務(ACID)的支持在單分片內非常完整;基于成熟的MySQL生態,開發和遷移成本相對較低。

- 挑戰: 擴展性并非完全彈性。擴容(如增加分片)通常涉及復雜的數據遷移與重分布,可能伴隨業務停機或性能抖動;跨分片的分布式事務支持弱,復雜查詢(如多表JOIN)需要應用層做大量改造,性能堪憂;運維復雜度高,需要管理多個數據庫實例及其之間的數據一致性。

TiDB(原生分布式):

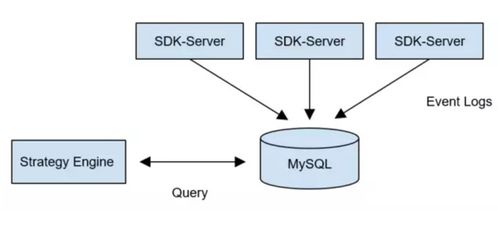

TiDB采用計算與存儲分離的云原生架構。計算層(TiDB Server)無狀態,負責SQL解析與事務管理;存儲層(TiKV)基于Raft協議實現數據的高可用與強一致性,并以Region為單位自動管理數據分片。

- 優點: 具備極強的水平擴展能力。通過簡單添加TiKV或TiDB節點即可實現存儲容量和計算能力的線性提升,且對業務幾乎透明,無需手動分片。原生支持分布式強一致性事務(樂觀鎖模型為主),跨節點的復雜查詢由TiDB層自動優化。

- 挑戰: 作為較新的數據庫,其周邊生態和深度運維經驗相較于MySQL略顯不足;在極高并發、純點查(如根據主鍵查詢)的場景下,可能因RPC開銷略遜于單分片MySQL;對硬件資源(特別是SSD和網絡)要求較高。

二、 數據處理能力

數據寫入:

MySQL分片: 寫入性能取決于分片規則的設計和單實例的瓶頸。良好的分片鍵(如用戶ID)能實現寫入負載的均勻分布。但熱點數據(如全局流水號)可能造成單個分片壓力過大。

TiDB: 寫入由PD(Placement Driver)組件調度,自動均衡到各個TiKV節點。其底層存儲引擎TiKV采用LSM-Tree,對順序寫入非常友好,能輕松應對千萬級的日增量。自動負載均衡機制能有效規避熱點問題。

復雜查詢與數據分析:

MySQL分片: 是此類場景的最大痛點。涉及多個分片的查詢(如全表掃描、多表關聯)需要中間件合并結果,效率低下,通常需要借助額外的OLAP系統(如ClickHouse)或大數據平臺。

TiDB: 憑借其分布式SQL引擎,能夠將復雜查詢下推到存儲節點并行執行,并通過MPP(大規模并行處理)架構顯著提升分析型查詢的性能。配合其生態中的列存引擎TiFlash,可實現HTAP(混合事務/分析處理),一份數據同時支持高并發事務和實時分析,簡化技術棧。

三、 存儲支持與服務(高可用、運維、生態)

高可用與容災:

MySQL分片: 高可用依賴于每個MySQL實例自身的主從復制(如半同步復制)或組復制(Group Replication),并結合VIP或代理切換。跨機房容災方案復雜,且數據一致性保障難度大。

TiDB: 高可用是內置的。TiKV通過Raft協議的多副本機制,確保少數副本故障時數據不丟失、服務不間斷。整個集群可輕松實現跨可用區部署,具備金融級的數據強一致性和高可用性。

運維復雜度:

MySQL分片: 需要管理多個獨立的數據庫集群,監控、備份、升級、擴縮容都是巨大的挑戰,對DBA團隊要求極高。

TiDB: 提供了完善的運維管理平臺(TiDB Dashboard)和云管服務(如TiDB Cloud),集成了監控、告警、慢查詢分析、熱力圖等多種功能,極大降低了分布式數據庫的運維門檻。但其分布式特性也意味著需要學習新的知識體系。

生態兼容性:

MySQL分片: 幾乎100%兼容MySQL協議和語法,現有基于MySQL的應用可以平滑遷移(但需適應分片規則)。

TiDB: 高度兼容MySQL 5.7協議和生態,絕大多數MySQL驅動、ORM框架(如MyBatis, Hibernate)、管理工具(如Navicat)可直接使用,遷移成本低。這是其得以快速推廣的關鍵優勢。

四、 落地選型建議

- 優先考慮MySQL分片方案: 當業務模型相對簡單,數據增長可預測,且團隊擁有深厚的MySQL運維經驗;初期投入預算有限,業務對跨分片復雜查詢需求極少;強依賴于MySQL特定功能或第三方工具。

- 優先考慮TiDB方案: 當業務處于快速增長期,數據量和并發量預期會大幅提升,需要彈性擴展能力;業務邏輯復雜,涉及大量關聯查詢或逐漸有實時數據分析需求(HTAP場景);追求更高的可用性標準(如RTO/RPO要求嚴格)并希望降低運維復雜度;團隊希望擁抱云原生分布式架構,為未來技術演進做準備。

****

面對日均千萬級的數據處理與存儲,MySQL分片方案更像是一場精心編排的“手工藝術”,在可控范圍內表現出色,但天花板明顯且運維負擔重。而TiDB則代表了一種“工業化”的解決方案,通過原生分布式架構提供近乎無限的彈性擴展、內置的高可用以及簡化的運維體驗,更適合應對未來不確定性的業務增長和海量數據挑戰。最終的選型,需緊密結合業務現狀、技術團隊能力和長遠發展規劃,進行綜合權衡。

如若轉載,請注明出處:http://www.baian888.cn/product/62.html

更新時間:2026-04-16 04:36:48